목차

- Ontology

- Taxonomic Knowledge

- Semantic Nets

- Expressiveness of Semantic Nets

- Frames

- Nonmonotonic Logic

- Circumscription

- Default Logic

- Difficulties with Nonmonotonic Logic

Ontology

: 철학, 무엇이 존재하는지 이야기하는 분야

AI 에서의 Ontology

: 지식 표현의 방법, 지식으로 부터 유추가 되기 쉬운 방향으로 지식을 표현

Taxonomic Knowledge

: 실제들은 보통 배열이 가능한데 계층적인 형태(Hierearchical structure) 또는 텍사노미(Taxonomy) 형태로 표현

ex) first-order logic

- 위 처럼 부분 집합(Subset) 관계를 형성

- 맴버의 엔터티(카테고리) 를 설정 가능

- sets 과 엔터티의 Properties (이를 통해 상속의 개념도 볼 수 있다. -> 그렇게 효율적으로 표현할 수느 없음 )

-> 조금 더 효율적으로 표현할 수 있는 방법은 없을까? Semantic Nets

Semantic Nets

: 위에서 언급했던 Taxonomy를 그래프(Graph) 구조로 표현

노드는 sets과 entities 를 표현

엣지는 1. Subset 2. member 3.properties 를 표현

상속(Inheritance) 표현 용이

자손 노드는 부모 노드의 모든 properties를 상속받지만 안 받을 수도 있음.

다중 상속(Multiple inheritance) 은 슈퍼클래스가 여러개일 때 properties 가 상충되면서 문제가 발생, 이는 우선순위를 정하여 해결할 수 있다.

Semantic nets 의 장점

- FOL 보다는 상속 관계를 modular way 로 표현 가능

- 예외를 다루기 쉬움

- 간단하고 효율적

Semantic nets 의 단점

- Negation

ex) 대머리인 사람은 머리가 긴 사람에 속하지 않는다.

이를 로직으로 나타내면 다음과 같이 간단하게 표현할 수 있지만 Semantic nets 에서는 쉽지 않음 엣지가 연결이 되지 않기 때문

- Disjunction

두가지 가능성에 대한 표현 쉽지 않음

- Quantification

ex) 모든 캐릭터들이 만화캐릭터다

이를 해결하기 위해 사용하는 것 'procedural attachment '

procedure 이 relation 의 값으로 사용

Frames

: Semantic nets 에서 Knowledge represent 를 하는 Data Structure

위에서 나왔던 Semantic nets 을 Frame 으로 표현하면 다음과 같음.

Nonmonotonic Logic

: 한 번 증가하면 절대 감소를 하지 않는 특성을 단조성(Monotonic)

위에서 언급했던 propositional logic& first-order logic 은 Monotonic logic

현실에서는 새로운 무언가가 나타났을 때 철회될(retracted) 가능성이 존재

-> 시스템 화 = Nonmonotonic logic(Circumscription, Default logic)

Circumscription

: 말그래도 회피하다, 부정하다 이런 의미

-Circumscription assumption:

특별한 state 가 있지 않는 한, 현재의 조건이 변하지 않고 예상이 다르지 않다.

= 특별한 state 가 있으면 변화할 수 있음.

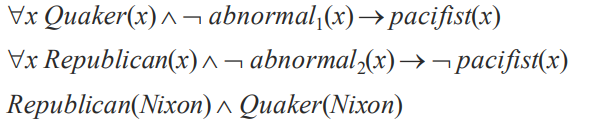

ex) circumscription을 위한 Logical statement

모든 새는 날 수 있다에서 abnormal 이라는 것이 나오게 됨.(부정)

Default Logic

현재 state 와 일관되면(Consistent) 결론(Conclusion)을 도출

A : prerequisite

Bn : consistent conditions

C : consequent

여기서 bi 가 일관적이지 않으면 A로부터 C를 이끌어 낼 수 없음

default theory , pair(D,W)

D 는 default rule의 set

W 는 FOL 의 집합

이의 extension은 결과의 maximal set

ex)

ex) Multiple extensions

두 개의 확장 가능

Difficulties with Nonmonotonic Logic

-지식의 변화가 있으면 Conclusions 의 수정이 필요

- 이와 같이 공식화 시켜 만들어진 Conclusions 으로 결정을 내리는 건 매우 어려움

-> 새로운 evidence 가 언제든지 등장할 수 있기 때문에

이에 대한 대안으로 다음에 배울 'Probablity theory'을 사용 가능

확률적으로 표현을 할 수 있다면 단순히 참 거짓이 아닌 적합한 걸 찾을 수 있음.

'공부 > 인공지능' 카테고리의 다른 글

| [인공지능] 9.Bayesian Networks (0) | 2020.10.16 |

|---|---|

| [인공지능] 8.Uncertainty (0) | 2020.10.15 |

| [인공지능] 6. Karush-Kuhn-Tucker(KKT) Approach (0) | 2020.10.14 |

| [인공지능] 5.Continuous State Spaces & Constrained Optimization Problem (0) | 2020.10.14 |

| [인공지능] 4.Local Search Algorithms (0) | 2020.10.13 |